Výzkumníci z Keen Security Lab zveřejnili obsáhlou 37stránkovou studii, v níž se věnují hned několika bezpečnostním zranitelnostem Tesly.

Průzkum byl zveřejněn nyní, avšak samotné testování probíhalo před několika měsíci a většina popisovaných chyb od té doby byla opravena. I tak však tato analýza poskytuje zajímavý pohled na stále se vyvíjející svět chytrých automobilů.

Tesla na dálkové ovládání

Výzkumníci se v textu věnují celé řadě problémů, z nichž některé ani přímo nesouvisí se softwarem Tesly, ale spíše s obecnou zranitelností AI.

Autoři studie dokázali například pomocí podvržení falešných dat spustit automatické stěrače aniž by pršelo. Na první pohled asi nejvíce šokujícím úspěchem výzkumníků pak bylo vzdálené ovládání Tesly pomocí gamepadu. Tento problém však byl způsoben bezpečnostní chybou, která byla opravena ještě před tím, než byla studie vůbec poskytnuta Tesle.

Oba výše popsané útoky byly technicky náročné a v reálném světě nepříliš snadno replikovatelné, neboť vyžadovaly přímé napadení řídícího softwaru vozu. Mnohem nebezpečnějším se proto jeví problém zmíněný v titulku článku.

Nebezpečné samolepky

Výzkumníci totiž zjišťovali, jestli lze pomocí fyzické úpravy vozovky zmást autopilota Modelu S, resp. jeho sledování pruhů. V prvním experimentu zkoušeli před autopilotem skrýt čáru na vozovce. To se jim sice povedlo, ovšem bylo kvůli tomu třeba specifickým způsobem silně narušit okraje čáry, což by opět bylo v běžném světě vcelku náročné a hlavně by si toho každý řidič na první pohled všiml.

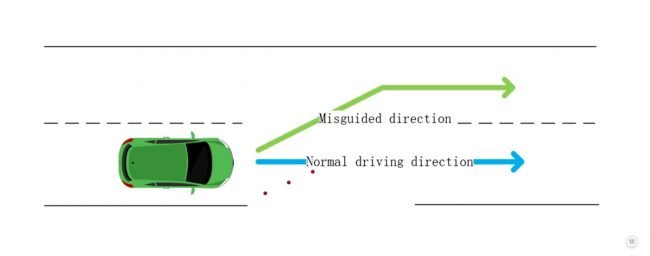

Když však zkusili opačný postup, tedy přesvědčit autopilota o existenci falešného pruhu, vše bylo mnohem jednodušší. Tři malé červené samolepky nalepené na silnici byly vše, co bylo třeba ke zmatení softwaru. Výzkumníci takto dokázali autopilota přinutit k tomu, aby odbočil do protisměru v domnění, že sleduje zahýbající pruh.

Tato zranitelnost působí ze všech nejrizikověji. Nalepit trojici samolepek na silnici totiž zvládne každý a vzhledem k jejich velikosti si jich řidič nemusí včas všimnout. Je samozřejmě otázka, jestli by Tesla skutečně do protijedoucího provozu zabočila, autopilot totiž nesleduje jen opticky pruhy, ale také okolní objekty (vozy) a to i pomocí radaru.

Paradoxně však zrovna u této chyby není jasné, jestli již byla opravena. Ve vyjádření Tesly ke studii totiž tuto informaci přímo nenajdeme. Automobilka ocenila práci výzkumníků a upozornila, že závažné chyby byly opraveny již aktualizacemi z roku 2017 a 2018. Ohledně zmatení stěračů a autopilota však ve vyjádření stojí pouze to, že nejde o realistickou obavu, neboť výzkumníci upravili okolní prostředí. Tesla navíc dodává, že řízení může v těchto situacích od autopilota kdykoliv převzít člověk, na což by měl být neustále připraven.