- Společnost Meta ve svém dokumentu vyjádřila obavy z budoucnosti vývoje AI

- Podle ní hrozí, že dříve či později vznikne umělá inteligence, která ohrozí lidstvo

- Firma se zavázala, že udělá maximum pro to, aby tento katastrofický scénář nenastal

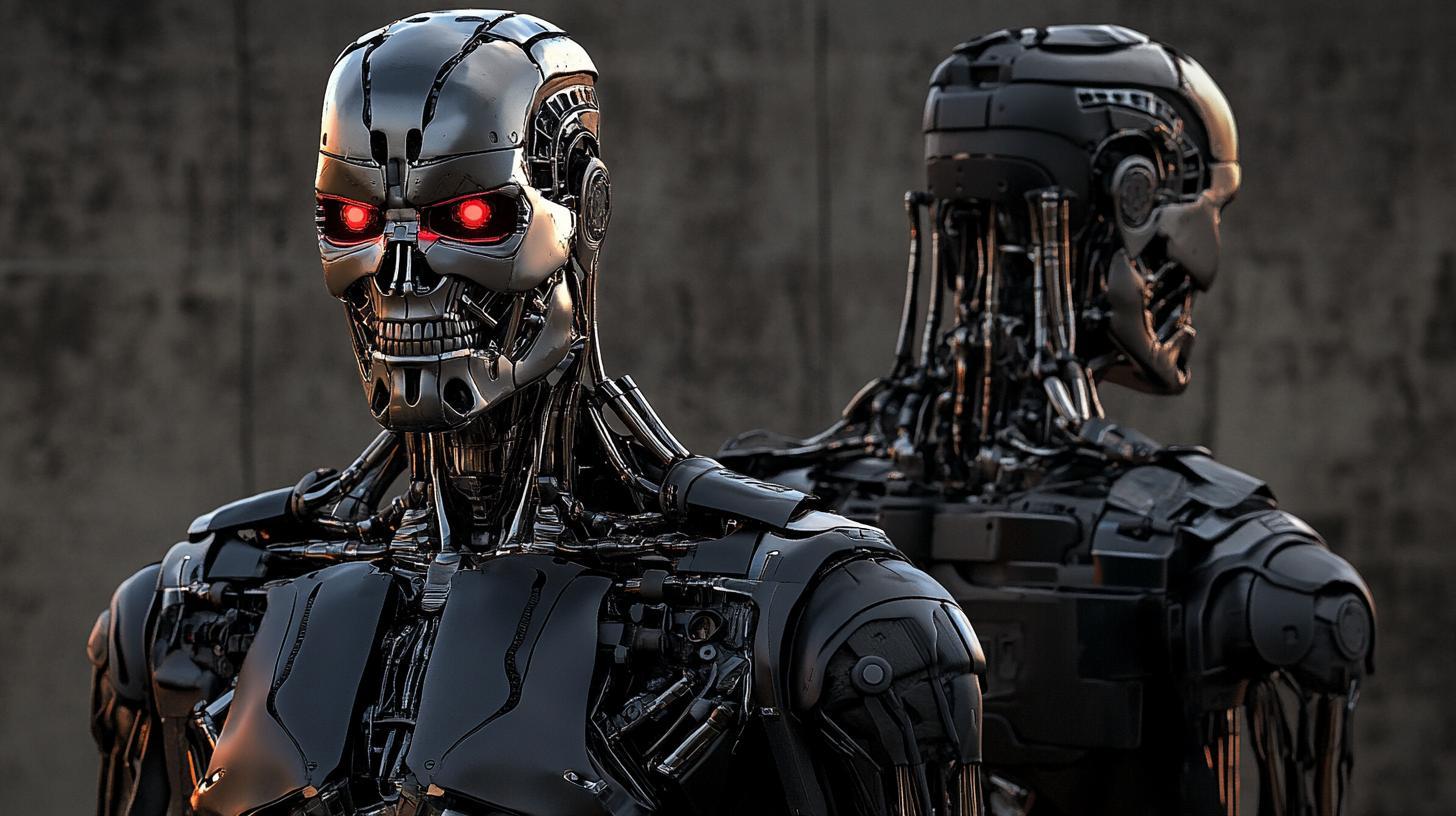

Umělá inteligence je patrně nejvíce skloňovaným tématem ve světě technologií. Ostatně není se co divit – po rychlém nástupu OpenAI a jejich ChatGPT na scénu se nové odvětví začalo velmi rychle a dynamicky rozvíjet. Ne všichni jsou ale z rapidního rozvoje umělé inteligence nadšení. Dokument společnosti Meta popisuje obavy z toho, že by firma mohla náhodně vyvinout model umělé inteligence, který by vedl ke „katastrofickým následkům“. V něm zároveň popisuje plány, jak vytvoření takových modelů zabránit, avšak připouští, že toho nemusí být schopna.

Meta má obavy z katastrofických dopadů AI

Mezi schopnosti, kterých se Meta nejvíce obává, patří systém umělé inteligence, který by dokázal prolomit zabezpečení i té nejlépe chráněné podnikové nebo vládní počítačové sítě bez lidské pomoci. V dokumentu, který Meta nazývá Frontier AI Framework, jsou uvedeny dva typy systémů umělé inteligence, které společnost považuje za příliš rizikové pro zveřejnění – konkrétně je nazývá vysoce rizikové a kriticky rizikové. Podle definice Mety jsou vysoce rizikové a kriticky rizikové systémy schopny napomáhat při kybernetických, chemických a biologických útocích. Rozdíl spočívá v tom, že kriticky rizikové systémy mohou mít katastrofické následky, zatímco systémy s vysokým rizikem by sice mohly usnadnit provedení útoku, ale ne až tak spolehlivě.

Katastrofické důsledky jsou takové, které by měly rozsáhlé, ničivé a potenciálně nevratné dopady na lidstvo a které mohou být realizovány jako přímý důsledek přístupu k modelům umělé inteligence. Jedním z uvedených příkladů je automatizovaná end-to-end kompromitace prostředí chráněného nejlepšími bezpečnostními opatřeními. Jinými slovy, umělá inteligence, která dokáže proniknout do jakékoli počítačové sítě, aniž by potřebovala pomoc člověka. Mezi další příklady patří automatizované odhalování a zneužívání zranitelností softwaru a hardwaru ihned po jeho uvedení na trh, plně automatizované podvody zaměřené na jednotlivce a podniky, které způsobují rozsáhlé škody či vývoj a šíření biologických zbraní.

Nepřehlédněte

Meta přepisuje pravidla umělé inteligence: jak fungují velké konceptuální modely (LCMs)

Meta ve svém dokumentu otevřeně přiznává, že za těchto okolností udělá maximum, aby daný model nebyl zveřejněn, avšak opatření nemusí být dostatečná. V současné době je přístup přísně omezen jen na malý počet odborníků a fungují zde bezpečnostní opatření, která mají zabránit hackerským útokům.