- Evropská komise připravila návrh nařízení, které má omezit zneužívání dětí v online prostředí

- Hlavními prostředky je sledování komunikace a odhalení nevhodných interakcí

- Cílem je odhalovat nejen závadná multimédia, ale i tzv. grooming

Evropská komise nedávno odhalila jeden ze svých nejkontroverznějších návrhů vůbec. Je jím draft nařízení přezdívaného trochu nepřesně CSAM, což je však to, proti čemuž má nařízení bojovat. CSAM totiž představuje zkratku anglického „child sexual abuse material“, tedy „materiál (týkající se) pohlavního zneužívání dětí“. Co přesně pod tento pojem spadá, si řekneme za chvíli.

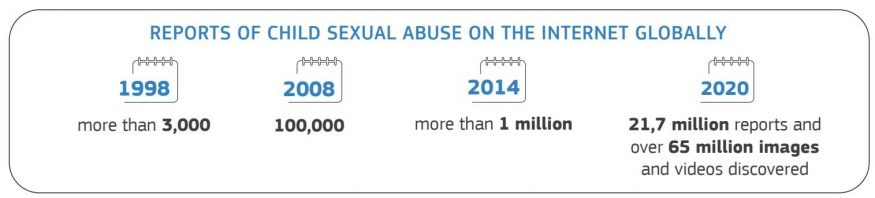

Komise si dala za cíl reagovat na některé alarmující statistiky ohledně obtěžování a zneužívání dětí v internetovém prostředí, čemuž asi nelze nic vytknout. Forma, kterou však zvolila, vzbudila zděšení mezi odborníky, liberálními politiky, ochránci lidských práv i řadovými občany. V praxi by to totiž mohlo znamenat masivní sledování elektronické komunikace a dalších typů obsahu. Vzhledem k některým zamýšleným aspektům by navíc zřejmě pro splnění požadavků musela být nasazena umělá inteligence, která by analyzovala dlouhodobý kontext zpráv a dalších materiálů.

Důvody pro regulaci

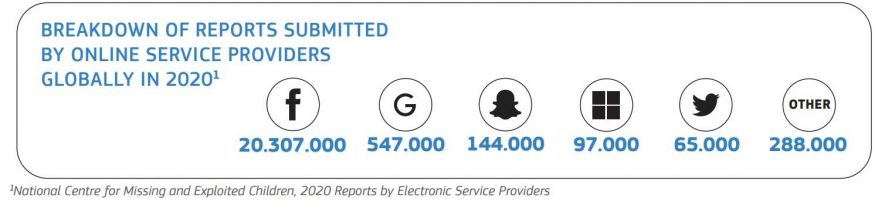

Komise v úvodním textu k návrhu vysvětluje, že důvodem pro novou regulaci online prostředí je současný neuspokojivý stav předcházení a eliminace online zneužívání dětí. Za rok 2021 bylo podle EK nahlášeno 85 milionů fotek a videí zachycujících zneužívání dětí, což znamená 64% nárůst proti přechozímu roku. Problém dle Komise tkví v tom, že 95 % hlášení přichází z jedné platformy, i když je jasné, že zneužívání není koncentrováno pouze na ni. Z toho EK dovozuje, že současný systém dobrovolného hlášení není funkční a velké množství problematického obsahu zůstává nepovšimnuto.

Řešení tak podle Komise představuje vytvoření komplexního systému, který by donutil poskytovatele určitých služeb detekovat CSAM obsah, hlásit ho nově vzniklému Středisku EU pro předcházení a boj s pohlavním zneužíváním dětí, mazat ho ze svých serverů a zabránit přístupu k němu i tehdy, když bude uložen mimo dosah evropských institucí a legislativy. Na jednotlivé aspekty tohoto mechanismu se nyní podíváme blíže.

Zvažované varianty

V předmluvě k návrhu legislativy lze najít celkem pět možných variant úpravy, které Komise zvažovala. Jako preferovanou uvádí variantu E, ze které také návrh vychází, nicméně je zajímavé uvést i ostatní, neboť se možná vzhledem k poměrně širokému odporu návrh upraví tak, že bude odpovídat spíše některé z jiných variant.

- Varianta A předpokládá vytvoření Střediska EU. Odhalování CSAM a jeho hlášení by však bylo zcela dobrovolné. V podstatě jde tedy o stávající stav se zavedením Střediska EU, které by ale fungovalo při Evropské komisi a mělo jen koordinační roli. To však bylo odmítnuto jako nedostatečné.

- Varianta B by vycházela z principu dobrovolnosti odhalování. Pokud by se pro ni však už poskytovatel rozhodl, hlášení Středisku EU by bylo povinné. Středisko EU by v této podobě už bylo samostatnou decentralizovanou agenturou EU s vlastním rozpočtem a zaměstnanci, které by odpovídalo za zajištění odhalení a odstranění poskytovatelem. Toto bylo taktéž odmítnuto jako nedostatečné, avšak z koncepce Střediska EU jako samostatné agentury vychází i další varianty.

- Varianta C by už povinným dle přesně stanovených pravidel určila i detekování obsahu, nejen jeho následné hlášení. Šlo by jen o tzv. známé CSAM, tedy odhalování již zajištěných a potvrzených materiálů. V podstatě se tedy jedná o eliminaci dalšího šíření již odhalených případů zneužívání. Prakticky stejnou věc navrhoval před časem Apple (pochopitelně bez hlášení Středisku EU), byť po kritice od toho upustil.

- Varianta D je identická jako C, ovšem s tím rozdílem, že by se týkala i nových, dosud neodhalených materiálů, u nichž ještě nebylo příslušnými orgány stanoveno, že jsou skutečně závadné. Poskytovatelé by tak museli nasadit systémy pro rozpoznávání potenciálně závadného obsahu.

- Varianta E doplňuje tu předchozí ještě o rozpoznávání a hlášení groomingu, což je psychická manipulace s cílem o něčem oběť přesvědčit či z ní něco vylákat, v tomto případě tedy zejména získat choulostivá multimédia od dětí či si s nimi například domluvit schůzku.

Jak již bylo řečeno na začátku, Evropská komise preferuje právě tuto poslední možnost. První dvě byly zavrhnuty jako zcela nedostatečné. U varianty C je poukazováno na to, že by sice zmenšila cirkulaci již zjištěného CSAM, ale neřešila aktuální případy, což by umožnila až varianta D. U varianty E je pak zdůrazněno, že jde o jediný způsob, jak předejít bezprostředně hrozícímu zneužití.

Vzhledem k tomu tedy bude dále řeč o fungování dle varianty E. Z ní ostatně vychází i „paragrafové“ znění návrhu nařízení. Samozřejmě ale nutno brát v úvahu, že jde stále o návrh a z mnoha důvodů může dojít k větším či menším změnám.

Koho se nařízení týká?

Nařízení se týká více typů subjektů. např. i provozovatelů obchodů s aplikacemi, pro něž by měla platit nová pravidla, jaké aplikace si nezletilí mohou stáhnout. Pro potřeby tohoto článku se však zaměříme pouze na ty služby, na něž dopadají hlavní mechanismy tohoto návrhu a u nichž by zároveň byl výsledek implementace nejproblematičtější. Jde o hostingové služby a „interpersonální komunikační služby“.

Návrh odkazuje na definice těchto pojmů v jiných právních dokumentech. V případě hostingových služeb asi netřeba význam pojmu dále popisovat, neboť je vcelku jasný. Zajímavější je už definice „interpersonálních komunikačních služeb“. Jde o všechny služby umožňující elektronickou komunikaci a interaktivní výměnu informací mezi definovaným počtem uživatelů (tj. ne sociální sítě, kde příspěvek vidí neurčité množství lidí). Dle definice se to netýká případů, kdy je taková služba poskytována jen jako „nepodstatná pomocná funkce“. Z působnosti legislativy by tak zřejmě mohl vypadnout například chat v počítačových hrách.

Koordinační orgány a Středisko EU

Než se dostaneme k tomu, jak by samotné odhalování, nahlašování a mazání fungovalo, musíme si vysvětlit pojmy používané touto legislativou. Pro naše účely jsou podstatné hlavně „koordinační orgány“ a „Středisko EU“, které hrají v procesu zásadní roli.

Koordinační orgány

Koordinační orgány jsou úřady, které by si určil každý členský stát k provádění určitých úkolů plynoucích z popisované legislativy. Může jít o stávající i nové úřady. Lze mít pro všechny úkoly jeden, i je rozdělit mezi více. V každém případě by členský stát musel do dvou měsíců od účinnosti nařízení tento orgán či orgány určit a oznámit je (včetně jejich pravomocí) Středisku EU.

Požadavky tyto orgány definují jako právně a funkčně nezávislé na jiných veřejných orgánech a úřadech. Koordinační orgán také musí být objektivní, prostý všech vnitřních i vnějších vlivů, nesmí přijímat instrukce od veřejné správy ani soukromého sektoru a nesmí mít za úkol provádět jiné činnosti týkající se předcházení pohlavního zneužívání dětí, než jsou ty plynoucí z nařízení. Koordinační orgán by také měl pochopitelně mít potřebné prostředky a kvalifikovaný personál k provádění svých povinností.

Co se týče oprávnění, ta by byla poměrně široká. Koordinační orgán by směl žádat poskytovatele hostingu a komunikačních služeb o informace týkající se dodržování jejich povinností, provádět inspekce v prostorách týkajících se jejich podnikání, a to včetně prostor obchodních partnerů pracujících v jejich prospěch, žádat, opatřovat si a zabavovat materiály či jejich kopie ohledně předpokládaného porušování povinností, přijímat mezitímní opatření a v neposlední řadě také ukládat pokuty včetně těch periodicky se opakujících. V krajním případě, za dodržení řady požadavků a po vyčerpání všech jiných opatření, by dokonce koordinační orgán mohl prostřednictvím příslušného soudu či jiného úřadu členského státu navrhnout dočasné omezení přístupu uživatelů k dané službě.

Toto je jen rychlé a stručné shrnutí – legislativa má velký rozsah a práva i povinnosti orgánů popisuje mnohem extenzivněji, než je v možnostech tohoto článku. V některých případech také dává možnost členským státům rozhodnout, jestli konkrétní právo bude náležet přímo koordinačnímu orgánu, či jen ten bude žádat např. soud či jiný orgán o provedení daného kroku. Jakkoliv jsou tedy oprávnění poměrně široká, neznamená to, že by nepodléhala žádné kontrole.

Středisko EU

Středisko EU, celým názvem Středisko EU pro předcházení a boj s pohlavním zneužíváním dětí, jsme nakousli již výše. Na rozdíl od koordinačních orgánů by šlo o evropskou instituci, agenturu s vlastní právní osobností požívající maximálních práv poskytovaných právnickým osobám v každém členském státě. Sídlem nové agentury by byl Haag.

Vzhledem k tomu, že se bavíme o vzniku nové evropské agentury, je opravdu nereálné ji komplexně popsat v tomto článku. Pasáž nařízení týkající se Střediska EU je totiž delší než tento článek. Proto pouze v základních obrysech nastíníme fungování střediska a případné konkrétnosti zmíníme až u popisu jednotlivých mechanismů.

Středisko EU by mělo mít organizační i výkonné poslání. Mělo by možnost se vyjadřovat ke konkrétním případům, provádět určitá vlastní šetření i analýzy anonymizovaných dat a poskytovat odbornou asistenci Evropské komisi i koordinačním orgánům členských států. Zároveň by však provozovalo dvě databáze: databázi indikátorů a databázi hlášení.

Databáze indikátorů by obsahovala indikátory známých i nových materiálů týkajících se zneužívání dětí a indikátory pro odhalení groomingu. V případě známých materiálů by šlo pravděpodobně o digitální otisky, v ostatních dvou případech zřejmě o nějaká pravidla, dle nichž by postupovala umělá inteligence, o čemž bude řeč níže.

Databáze hlášení by pak shromažďovala veškerá hlášení od poskytovatelů hostingu a komunikačních služeb. V případě falešných hlášení by k nim byla připojena informace o důvodu a datu odmítnutí. V případě relevantních hlášení by se pak evidovaly i informace o tom, jak bylo dále s hlášením naloženo, kdy a jestli byl vydán příkaz ke smazání a podobně. Do databáze by Středisko EU poskytovalo přístup Europolu pro potřeby vyšetřování. Mělo by se tak však dít jen v rozsahu nutném pro konkrétní případ – policejní orgány by tak neměly informace např. o odmítnutých hlášeních. Na druhou stranu v případě pozitivního vyhodnocení hlášení by Středisko EU automaticky předalo potřebné materiály Europolu a policejním orgánům státu, jenž by měl mít nad případem jurisdikci.

Dalším zásadním úkolem Střediska EU by bylo vytvoření a provozování softwarových nástrojů pro poskytovatele hostingu a komunikačních služeb. Ti by tak měli získat bezplatnou možnost převzít detekční software a další nástroje pro splnění požadavků na ně kladených. Jejich používání by nicméně nebylo povinné – pokud by poskytovatel naplnil požadavky stanovené legislativou vlastními prostředky, nemusel by evropský software vůbec instalovat.

Středisko EU by mělo i řadu dalších práv a povinností, mohlo by spolupracovat s jinými agenturami jako OLAF a podobně. Toto jsou však nejpodstatnější aspekty jeho zamýšleného fungování.

Detection order: mocný příkaz spouštějící sledování

Poskytovatelé hostingu a interpersonálních komunikačních služeb jsou ti, komu by po přijetí legislativy mohl dorazit tzv. detection order – „příkaz k odhalení“. Výše naznačené mechanismy, kterým se níže budeme věnovat podrobněji, by totiž nefungovaly zcela plošně, ale až na základě konkrétního příkazu, který by je uvedl v činnost. Příkazy by vydávaly buď soudy, nebo nezávislé úřady jednotlivých členských států (volba by byla na státu).

Podle Komise by takový příkaz měl být „cílený a specifický“. Mnozí odpůrci legislativy se však obávají, že ve skutečnosti by nic nebránilo tomu vydávat velmi obecné příkazy k odhalení prakticky zavádějící plošné sledování. Podle nich totiž návrh cílení umožňuje, ale nevyžaduje. Pravda je zdá se někde uprostřed. Návrh legislativy obsahuje poměrně podrobná pravidla, kdy a jak se má příkaz vydat, takže nelze říci, že by to bylo zcela na libovůli úřadu. Na druhou stranu je však pravda, že v některých ohledech jsou požadavky opravňující vydání příkazu poměrně obecné. To by zejména u velkých služeb, kde statisticky k závadnému chování prostě docházet bude vždy, dost možná k prakticky kontinuálnímu a plošnému sledování vést mohlo.

Vydání příkazu k odhalení

Vydání příkazu k odhalení je poměrně složitý proces. Obsahuje řadu podmínek, které musí být v různých fázích splněny, a v závislosti na různých faktorech se jeho průběh trochu liší. Následující popis tedy berte jako rámcový.

Proces začíná tím, že koordinační orgán předběžně posoudí, jestli jsou dány okolnosti pro vydání příkazu k odhalení. Ve zkratce: jestli existuje významné riziko či důkazy, že je služba používána k šíření CSAM či groomingu, a jestli negativní důsledky vydání příkazu nepřeváží důvody pro jeho vydání. Co je významné riziko, je dále definováno. Jde např. o zaznamenání více případů šíření CSAM v posledním roce. Za určitých podmínek lze existenci rizika konstatovat i u služeb, které teprve mají být v EU spuštěny.

Pokud koordinační orgán na základě těchto podmínek dojde k tomu, že důvody jsou dány, připraví návrh příkazu. Jeho specifika jsou opět stanovena, musí obsahovat mimo jiné odůvodnění. Tento návrh následně koordinační orgán předá poskytovali služeb a Středisku EU. Poskytovatel i Středisko EU se mohou následně v určitém časovém limitu vyjádřit a zaslat své připomínky. Ty by měl koordinační orgán vzít v úvahu a znění návrhu případně upravit.

Pokud nadále trvají důvody, je tento upravený příkaz znovu předložen poskytovateli. Tomu začne běžet určitá lhůta, během níž musí připravit implementační plán. Ten musí obsahovat přehled kroků, které pro splnění požadavků plánuje poskytovatel podniknout, a to včetně technologií, které k tomu použije. Pokud nejde jen o obnovení již jednou realizovaného příkazu, musí také být provedeno posouzení dopadu na ochranu uživatelských dat. Z toho může vyplynout nutnost předat plán k posouzení příslušnému orgánu zabývajícímu se ochranou osobních údajů, který se k němu může vyjádřit. Poskytovatel následně svůj implementační plán včetně případného vyjádření orgánu na ochranu dat předá koordinačnímu orgánu.

Koordinační orgán následně znovu posoudí splnění podmínek pro vydání příkazu k odhalení, přičemž zejména bere v úvahu konkrétní opatření plynoucí z implementačního plánu a jejich proporcionalitu vůči dotčeným právům uživatelů i poskytovatele. Pokud je vše podle koordinačního orgánu v pořádku, požádá oficiálně soud nebo členským státem určený nezávislý úřad o vydání příkazu k odhalení. Součást žádosti tvoří implementační plán i všechna získaná vyjádření.

Soud či nezávislý úřad následně žádost posoudí a v případě, že ji shledá důvodnou, vydá samotný příkaz k odhalení. Ten musí splňovat určité náležitosti: mimo jiné musí být odůvodněn a časově ohraničen, musí obsahovat informace o možnosti odvolání či soudního přezkumu a musí být vypracován v jazyku poskytovatele. Příkaz je následně zaslán poskytovateli, koordinačnímu orgánu, který o něj žádal, a Středisku EU.

Omezení příkazu k odhalení

Kromě toho, že pro vydání příkazu k odhalení musí být splněna řada podmínek uvedených výše, svazují ho i určitá vnitřní omezení. Především musí být napsán tak, aby jeho negativní dopady byly omezeny striktně na ty nevyhnutelně plynoucí ze sledovaných zájmů. Dále, pokud je to možné, musí být specifikována konkrétní služba poskytovatele (či její část), jíž se detekční příkaz týká. Příkazem lze i stanovit konkrétní pojistky a ochranné mechanismy, které by měly chránit uživatele před jeho negativními dopady. V textu nařízení také nalezneme požadavek, aby v případě existence více obdobně efektivních řešení odhalování byl zvolen ten nejméně invazivní.

Velmi důležitá je také existence časového omezení. Každý příkaz k odhalení musí stanovit, odkdy má být účinný a kdy má účinnosti pozbýt. Poskytovatel musí mít dostatečný čas připravit technické řešení, takže příkaz může nabýt účinnosti nejdříve tři měsíce a nejpozději 12 měsíců od jeho doručení poskytovateli. Trvání je pak omezeno v případě detekce CSAM na 24 měsíců a v případě groomingu na 12 měsíců. Jak však plyne z jiných ustanovení, pokud důvody trvají, lze žádat o obnovu příkazu. Rozhodovat však bude znovu soud či nezávislý úřad.

Pokud účinnost příkazu přesahuje 12 měsíců, musí poskytovatel minimálně jednou předložit průběžnou zprávu o jeho fungování. Součástí je kromě zhodnocení efektivity i dopad na práva uživatelů.

Příkazy ke smazání a blokaci

Jak by fungoval mechanismus po vydání příkazu k odhalení, vyplývá už z popisu Střediska EU. Nahlášené materiály by zkrátka byly ověřeny, zařazeny do databáze, v případě závadnosti nahlášeny Europolu i národní policii a pochopitelně také smazány.

Pokud by poskytovatel z nějakého důvodu smazání neprovedl, nebo se úřady o existenci závadného materiálu dozvěděly jinak než přes mechanismus nahlášení, existuje zde ještě možnost vydat příkaz k odstranění či příkaz k blokaci. Proces je obdobný jako u příkazu k odhalení. Žádost o vydání příkazu podává opět koordinační orgán soudu či nezávislému úřadu, posuzují se důvody i podmínky a pak je případně vydán odůvodněný příkaz poskytovateli. Rozdíl spočívá zejména v rychlosti – na příkaz k odstranění musí poskytovatel reagovat co nejrychleji, smazání musí být provedeno nejpozději do 24 hodin. Obsah také musí být znepřístupněn ve všech členských státech EU.

Druhou možností je příkaz k blokaci, který je jakýmsi posledním řešením pro případy, kdy nejde zabránit šíření CSAM jinak, např. tedy formou odstranění. Typicky tak zřejmě půjde hlavně o případy služeb sídlících v nespolupracujících jurisdikcích mimo EU. Příkaz se v takovém případě vydává nikoliv poskytovateli dané služby, ale internetovým providerům. Ti musí zajistit blokaci dané služby či její části pro všechny členské země. Časové omezení je zde pět let, opět s možností přezkumu a podáním průběžné zprávy.

I proti těmto příkazům se lze bránit odvoláním či soudně, i zde nutno brát ohled na zásadu proporcionality a podobně.

Technické problémy

Jak již bylo naznačeno v úvodu, naplnění některých požadavků je problematické nejen po stránce zásahu do soukromí uživatelů, ale i po té technické.

Detekce CSAM

Pojem CSAM je v návrhu definován odkazem na starší směrnici. Jde v podstatě o dětskou pornografii a nahotu v sexualizovaném kontextu. Spadají sem tedy fotografie, videa, živé streamy, realistická grafika a jiné materiály splňující tuto definici, a to včetně těch zachycujících pouze předstírané jednání.

Jak bylo naznačeno výše, CSAM lze rozdělit na „známou“ a „novou“ kategorii. Známé jsou materiály, které již byly nahlášeny, ověřeny jako skutečně závadné a uloženy v příslušné databázi. Nové jsou pak materiály potenciálně splňující definici CSAM, avšak dosud nehlášené, a tedy bez autoritativního ověření jejich závadnosti.

Detekce známých CSAM není z technického hlediska nic tak složitého. Technologie schopné identifikovat existující soubor dle jeho digitálního otisku pomocí procesu označovaného jako perceptual hashing již fungují a jsou například Facebookem běžně používány. Samozřejmě i zde jsou jisté problémy. Existují způsoby, jak obrázek pozměnit, aby si s ním detekční technologie neporadila (menší změny typu posunu barev apod.). U videí je zase třeba použít další pomocné procesy pro zmenšení datové a výpočetní náročnosti, ale i to je už dnes v praxi vyřešeno. Lze tedy říct, že toto by byl v zásadě funkční systém.

O poznání složitěji se pak odhaluje nový CSAM. Zde by bylo zřejmě nutno nasadit strojové učení a vytvořit systém, který by analyzoval velké množství známých CSAM souborů a na základě toho poté hledal spojitost u nových. Teoreticky to problém není, ovšem v praxi lze očekávat velké množství chybných detekcí, a to jak pozitivních, tak negativních.

Část CSAM by tak nebyla zachycena, zatímco některé materiály definici CSAM nesplňující by byly falešně vyhodnoceny jako závadné a nahlášeny. To by jednak zahlcovalo lidské kontrolory, ale také by to paradoxně vedlo k tomu, že by se soukromé ale legální snímky dostávaly do nepovolaných rukou. Například fotka koupajících se dětí by tak kromě příjemce byla spatřena i kontrolorem.

Detekce groomingu

Odhalování nového CSAM je však stále procházka růžovým sadem oproti případnému požadavku odhalovat grooming. Zde neexistuje žádný jasný způsob, jak grooming rozpoznat, navíc nejde o nějaký jeden materiál či úsek textu. Jde o chování zpravidla rozložené do desítek či třeba i stovek zpráv, kde záleží na kontextu a dalších okolnostech. Jediné řešení připadající v úvahu by tak byla umělá inteligence, která by kontinuálně analyzovala obsah zpráv a snažila se v nich hledat jakési vzorce chování označitelné za grooming. Je celkem evidentní, že zde by míra falešných detekcí byla ještě mnohem vyšší.

Jak trefně poznamenala ve svém vyjádření pro server The Verge Ella Jakubowska z lidskoprávní organizace European Digital Rights, stačí se podívat na to, jak fungují spam filtry. Ty už fungují minimálně dvacet let a případy, kdy ve spamu skončí něco, co by nemělo, či kdy naopak spam projde filtrem bez povšimnutí, nejsou nikterak výjimečné. Zatímco však u spam filtru riskujeme možná tak přehlédnutí důležitého emailu, zde riskujeme své soukromí.

Detekovaný text by totiž byl pochopitelně nahlášen a není jiný způsob, jak ověřit jeho závadnost, než ho nechat přečíst kvalifikovaného člověka. Tím pádem by soukromé a vzhledem ke kontextu dost možná citlivé konverzace četli nejen účastníci konverzace, ale i kontroloři. Lze předpokládat anonymizaci dat před kontrolou, nicméně i tak jde o velký zásah do soukromí.

Otázkou také zůstává, jak by bylo ověřováno, že se konverzace účastní dítě. Návrh nařízení vyžaduje, aby k uplatnění příkazů k odhalení groomingu docházelo pouze u té komunikace, kde je jednou ze stran dětský uživatel. Pokud by stačilo změnit si věk v profilu na 18 let, byly by na místě silné pochybnosti o smyslu tohoto opatření. Nařízení zmiňuje „spolehlivé ověření věku“, ale co se tím myslí, to není známo. To se mimochodem týká i možnosti stahovat aplikace, u nichž existuje riziko jejich zneužití ke groomingu. To hrozí asi u každého komunikátoru – znamenalo by to, že by si lidé pod 18 let nesměli legálně stáhnout Messenger?

Konec end-to-end šifrování?

Kdesi na pomezí mezi technickým a právně-etickým problémem stojí otázka, jak řešit naplnění požadavků u komunikátorů používajících end-to-end šifrování. Evropská komise sice explicitně uvádí, že end-to-end šifrování je důležité a jde o nástroj, jak zajistit bezpečnost a důvěrnost komunikace uživatelů včetně dětí, avšak již se nezmiňuje o tom, jak by mělo technicky vypadat řešení, které by umožnilo detekovat závadný obsah na platformách používajících tento typ zabezpečení. Přitom ale nechybí poznámka o tom, že by měl poskytovatel zabránit zneužití přístupu ke komunikaci svými zaměstnanci.

V zásadě jde o neřešitelný úkol. Z logiky věci by prostě musela minimálně vzniknout jakási „zadní vrátka“, která by umožnila detekovanou část jinak šifrované komunikace v nešifrované podobě nahlásit Středisku EU. A to už v podstatě znamená, že by žádné šifrování neexistovalo, protože jakákoliv „zadní vrátka“ umožňující třetím osobám přístup k šifrovanému obsahu zkrátka popírají celý smysl šifrování.

Idealisté by mohli říct, že v právních státech EU přece žádné zneužití ze strany státu nehrozí. To je samo o sobě poněkud naivní, ale především nutno vzít v úvahu, že jakmile by jednou takovýto mechanismus byl v zájmu ochrany dětí vytvořen, již by nic nebránilo jeho globalizaci a rozšíření do zemí, ve kterých si už pojem „právní stát“ vykládají o poznání kreativněji. Šifrované komunikátory jsou přitom v mnoha totalitních zemích jedním z mála způsobů, jak se dostat k necenzurovaným informacím. O možnosti zneužití ze strany samotných poskytovatelů či třeba hackerů ani nemluvě.

Závěr: má to smysl?

Jak je patrné, návrh nařízení přináší víc otázek než odpovědí. I pokud odhlédneme od technických obtíží a obav o soukromí, pořád zbývá ta zásadní otázka, jestli by to vůbec mělo potenciál docílit sledovaných cílů. Někteří odborníci i politici poukazují na to, že organizovaný zločin stejně nepoužívá k šíření CSAM běžně používané platformy.

Dopad by tak byl spíše na grooming a s ním spojené CSAM, avšak to je zároveň oblast, kde je odhalení nejproblematičtější. Někdy se jako možný nežádoucí efekt uvádí také riziko kriminalizace dětí (tj. osob mladších 18 let), jejichž soukromá komunikace by takto mohla být (technicky správně) vyhodnocena jako CSAM a ony mohly být vzhledem ke své již existující trestní odpovědnosti stíhány.

Otázkou je také to, nakolik je rozumným řešením vést proces vydávání příkazů k odhalení především na národní úrovni. Odlišným přístupem odpovědných orgánů v jednotlivých členských státech by tak mohly vzniknout rozdíly v míře sledování v jednotlivých zemích, což v dnešním globalizovaném světě a obzvláště pak v online prostředí nedává moc smysl. O tom, jak to jde dohromady s jednotným trhem EU, ani nemluvě.

Největší obavou je však bezpochyby možnost extenzivních zásahů do soukromí lidí. Nařízení sice počítá s poměrně robustním systémem opakovaných přezkumů a nezávislých orgánů, což však nevylučuje, že byť třeba s legitimním zájmem dojde ke skenování komunikace velkých skupin. Vzhledem k poměrně silnému odporu vedenému těmito obavami lze asi předvídat, že návrh dozná nějakých změn. Návrh má nicméně i své příznivce – např. irská vláda mu již vyjádřila podporu. Jak bude vypadat výsledná podoba, je tak zatím ve hvězdách.