Umělá inteligence se rozvíjí závratnou rychlostí a nezadržitelně se blíží doba, kdy bude schopna uvažovat sama o sobě. Rozbíhají se tedy výzkumy, jak ji udržet v mezích, aby neohrožovala lidské pokolení.

Mnoho velkých mozků dnešní doby, například Stephen Hawking, Bill Gates nebo Elon Musk, pravidelně vyslovuje své obavy ohledně vývoje umělé inteligence. Ta podle nich není tak růžová, jak by se na první pohled mohlo zdát.

Již od počátku vývoje výpočetní techniky se objevovaly otázky, zda nás může někdy náš vlastní výtvor překonat. Prozatím je jedním z nejdokonalejších systémů superpočítač Watson od firmy IBM, který je schopen pracovat s daty z historie, s fakty a dalšími informacemi a sám se je učit. I díky tomu dokázal vyhrát Jeopardy, americkou obdobu soutěže Riskuj! Spolu s takto rychlým vývojem roste i tlak na kontrolu a vytváření mantinelů, ve kterých by se měl umělý mozek pohybovat, aby nedošlo k ohrožení lidstva.

Superpočítač Watson od firmy IBM vyhrává v soutěži Jeopardy

37 výzkumných týmů v čele s Oxfordem

Elon Musk, zakladatel projektu SpaceX a spoluzakladatel automobilky Tesla, v lednu daroval 10 milionů dolarů (zhruba 250 milionů Kč) institutu The Future of Life, který nyní 7 milionů (175 milionů Kč) z tohoto daru přerozděluje mezi 37 vybraných výzkumných týmů. Ty budou hledat odpovědi na mnoho otázek ohledně umělé inteligence. Granty budou týmům vypláceny v horizontu 3 let podle toho, jak se jim bude ve výzkumu dařit.

Úvodní obrázek na LinkedInu institutu The Future of Life: “Technologie dala životu příležitost rozkvést jako nikdy předtím… a nebo zničit sebe sama.”

Největší grant dostane Oxfordská univerzita, konkrétně 1,5 milionu dolarů (37 milionů Kč), která bude mimo jiné zkoumat především dlouhodobé dopady existence umělé inteligence. Také slíbila vytvoření zásad, jež budou minimalizovat rizika související s využíváním počítačových mozků a naopak maximalizovat prospěch z jejich využívání.

Machine Intelligence Research Institute (Institut pro výzkum strojové inteligence) dostane grant 250 000 dolarů (6,25 milionů Kč), s jejichž pomocí bude zjišťovat, jak udržet zájmy a hodnoty umělé inteligence v souladu s těmi lidskými.

Na Univerzitu Carnegie Mellon poputuje dalších 200 000 dolarů (5 milionů Kč) na hledání možností, jak by mohly počítače vysvětlovat svá rozhodnutí lidem, abychom je byli schopni pochopit. Univerzita v Duke dostane taktéž 200 000 dolarů a zaměří se především na možný konflikt etiky a umělé inteligence.

Další týmy se zaměří například na to, jak naučit roboty rozeznávat řeč těla a na základě toho poznat, co člověk od umělé inteligence očekává, nebo na to, jak zajistit, aby se roboti a inteligentní zbraně nevymkly lidské kontrole.

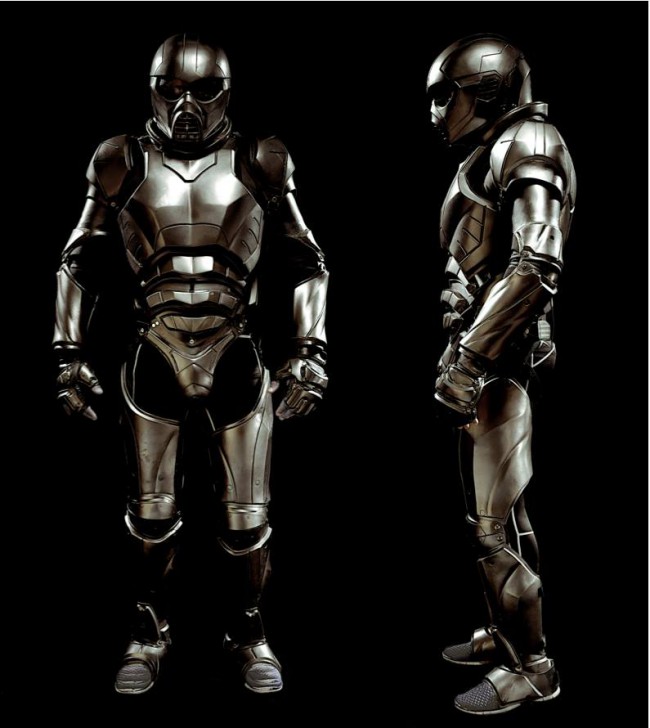

Takto vypadá prototyp inteligentního brnění Lorica, budou takto jednou vypadat i robotičtí vojáci?

Mnoho povyku pro nic?

Institut Future of Life se podporou těchto týmů nesnaží vyvolat paniku, spíše se snaží pohlížet do budoucna a vyvarovat se případným nevítaným následkům, které by mohly plynout z rychlého a ničím nekontrolovaného vývoje umělé inteligence. Vzhledem k velikosti finančních prostředků, které institut přerozděluje, je však zřejmé, že tento problém nebere na lehkou váhu a samotný Elon Musk by nejspíše byl rád jedním z těch, kteří budou mít na regulace v této oblasti velký vliv.

Podobné iniciativy mě samotného vedou k zamyšlení, zda fakt, že očekáváme, že nás námi vytvořená umělá inteligence bude chtít zničit, odráží naši lidskou povahu. Proč by nás chtěla vymazat z povrchu Země? Bylo by to chybou lidského programování, nebo by se sama mohla dostat k závěru, že vzhledem k našim nárokům na planetu a jejímu drancování je naše existence neefektivní a planetě by prospělo, kdybychom zde nebyli?

I neznámé objekty na obloze se snažíme nejdříve zlikvidovat, a až poté zkoumat. Z čeho plyne tento pocit ohrožení a neustálá snaha chránit se všemi možnými prostředky? Je to pud sebezáchovy, určitá paranoia, nebo zkrátka touha mít vše pod kontrolou a nenechat nic náhodě, což bohužel, vzhledem ke komplexnosti našeho světa, není možné? Bojíme se sami sebe a podezříváme tedy, pro jistotu, jeden druhého? Chceme umělou inteligenci primárně využívat jako zbraň? Nebo se jen snažíme jednat s velkou opatrností a nic z výše uvedeného nehraje roli?

Jaký je váš názor na tuto problematiku a její další vývoj? Jsou podobné výzkumy oprávněné, nebo se jedná o mrhání penězi?